Facebook abortó un desarrollo de inteligencia artificial luego de que dos robots crearan su propio lenguaje. La noticia, así contada, rebotó en los principales sitios de noticias del mundo y abonó la profecía de una pronta rebelión de las máquinas. El fundador de PayPal y Tesla Motors, Elon Musk, aprovechó para criticar al CEO de la red Social, Mark Zuckerberg, por su comprensión limitada de los riesgos de la Inteligencia Artificial (I. A.), y de inmediato la generación Terminator empezó a buscar un fisicoculturista del futuro para que salve a la especie.

Lo cierto es que los ingenieros de Facebook olvidaron establecer el idioma inglés en una línea de código al programar sus robots, y que nada prevé que la ominosa red Skynet se lance, como en la ficción, a la conquista del mundo. Pero mientras la preocupación se orienta hacia la ciencia ficción, ya existen programas de I. A. que se utilizan no sólo para recomendar qué ruta tomar, dónde comer o qué hacer en un día lluvia, sino también para, por ejemplo, establecer condenas judiciales, alertar a la policía por focos de protesta antes de que escalen o predecir posibles perpetradores de delitos para su seguimiento, hechos concretos que afectan la vida de las personas y cuyas decisiones están basadas en criterios desconocidos para la mayoría.

Hollywood en casa

Eric Loomis fue condenado a seis años de prisión por esquivar un control policial en un auto robado en Wisconsin (EE UU). El juez basó su sentencia en la recomendación COMPAS, un software que calcula la probabilidad de reincidencia criminal. Loomis apeló el fallo pidiendo que le explicaran cómo el programa había recomendado esa pena. El caso llegó a la Corte y en abril de 2016 el tribunal estableció que no hacía falta conocer el algoritmo ejecutado sino simplemente el resultado. Loomis sigue en prisión y el software desarrollado por la firma Northpointe continúa asesorando jueces según patrones que permanecen en una caja negra.

Otros programas semejantes son usados por el sistema penitenciario estadounidense para definir qué tipo de supervisión o de encarcelamiento necesitan los presos y calcular el riesgo de que cometan otro crimen si salen bajo fianza o en libertad condicional. El problema no es tanto el desconocimiento del proceso con el que las computadoras obtienen sus resultados; por el contrario, se sabe que son tendenciosos. En mayo del año pasado, el sitio de investigación ProPublica descubrió que el software usado para recomendar penas incluía un sesgo que discriminaba a los negros: la tasa de probabilidad de reincidencia duplicaba a la de los blancos. El sitio analizó 7000 arrestos ocurridos en el estado de Florida entre 2013 y 2014 y chequeó cuántas personas que, según predecía el programa, volverían a incurrir en delitos, lo habían hecho efectivamente: sólo el 20 por ciento.

En diciembre pasado, la Unión Americana por las Libertades Civiles (ACLU por sus siglas en inglés) denunció que la policía de EE UU estaba usando otro programa desarrollado por una empresa privada que analizaba información de Facebook, Twitter e Instagram para identificar activistas negros en el marco de protestas por discriminación racial. Se supo entonces que Geofedia, tal el nombre de la aplicación que analizaba y geolocalizaba mensajes en las redes, tenía contratos firmados con unas 500 dependencias de fuerzas de seguridad de todo el país. Tras el escándalo, las tres redes sociales más populares anunciaron que interrumpirían su provisión de datos a Geofedia. Poco después, Muckrock, un sitio de investigación periodística que aboga por la transparencia gubernamental, informó que otras firmas como Media Sonar o MagnetForensics ofrecen el mismo servicio incluso a menor precio.

Aprendizaje automático

Es difícil definir la noción de Inteligencia Artificial. Es más bien filosófico: equivaldría a pensar si uno es capaz o no de distinguir una máquina de un humano cuando interactúa, ya sea en un chat, jugando al ajedrez o a los videojuegos, por citar ejemplos comunes. En todos los casos, las inteligencias artificiales deciden qué conviene hacer en cada momento en base a una programación previa, explica Leandro Lombardi, doctor en Matemática y miembro del programa de Ciencia de Datos de la Fundación Sadosky. Pero lo que genera más noticias y temores es una supra I. A., que es el aprendizaje de máquina (machine learning). Esto es, entrenar computadoras para que analicen los datos disponibles y saquen conclusiones. Se les muestra un criterio y se les pide que lo apliquen.

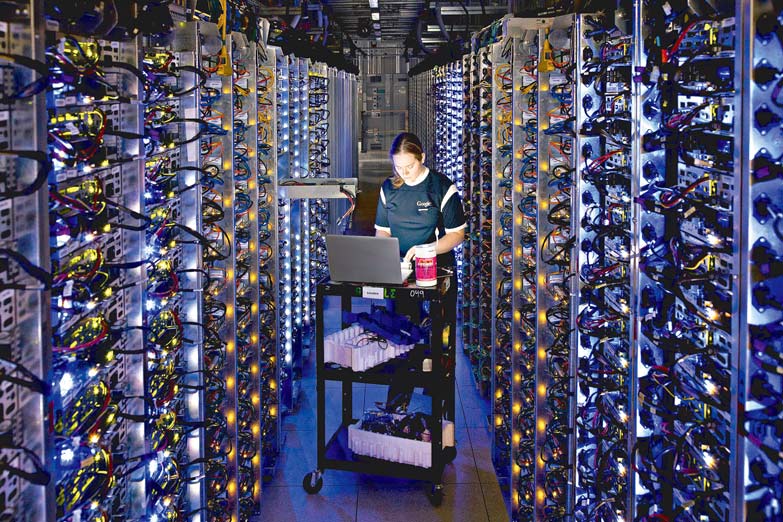

Hoy convivimos con este tipo de tecnología. Desde la caracterización de un mail como spam hasta el reconocimiento facial para el etiquetado de fotos en Facebook; desde la decisión del colectivo más rápido a tomar en una app del celular hasta las respuestas que ofrece el buscador de Google a cualquier pregunta. Siempre que hablemos de resultados obtenidos en base a un procesamiento de grandes volúmenes de información (Big Data), estamos hablando de Inteligencia Artificial. El tema es el sesgo de quien la programe.

La I. A. no discrimina, sólo busca la mejor respuesta matemática a un problema sin tener en cuenta cuestiones éticas o políticamente correctas, por eso la importancia de que haya supervisión humana, insiste Lombardi. En ese marco deben repensarse las dudas que suscitó el software que sugiere penas judiciales por su discriminación a los negros. Probablemente, el algoritmo ya tenía incorporado que la tasa de negros encarcelados en EE UU duplica su proporción demográfica, o que en promedio reciben sentencias 20 veces más altas que los blancos por crímenes similares (según un análisis de la Comisión de Sentencias sobre casos entre 2007 y 2011). Aquellas condenas sin computadoras evidenciaban la discriminación del sistema creado por los hombres. Cuando esos mismos hombres se dejan guiar por el algoritmo, ratifican su sempiterno criterio discriminador.

Riesgo letal

«Necesitamos ser proactivos en la regulación de la I. A., y no reactivos. Porque para cuando seamos reactivos, podría ser muy tarde». La frase cobra relevancia en los labios de Elon Musk, el emprendedor tecnológico sudafricano que, además de autos eléctricos y sistemas de pago electrónico también regentea Space X, la compañía que busca llevar gente a Marte. Se refería, especialmente, al desarrollo de armas letales autónomas.

Musk, junto a Steve Wozniak cofundador de Apple, el matemático Stephen Hawking, el filósofo Noam Chomsky y Jaan Tallin creador de Skype, entre otros, firmaron una carta abierta para pedir que se regule la producción de lo que llamaron las Kalashnikov del mañana. Creemos que la Inteligencia Artificial tiene un gran potencial para beneficiar a la humanidad en muchas maneras, y ese debe ser el objetivo de su desarrollo. Pero la carrera por el desarrollo militar de I. A. es una mala idea y debe ser prevenida, para prohibir una ofensiva autónoma de armas fuera del control humano, señala la misiva dirigida a la ONU.

La Inteligencia Artificial tiene riesgos, explica Valentín Muro, estudiante de filosofía especializado en cultura hacker. Algunos están sobreestimados, como la posibilidad de que agentes automáticos adquieran conciencia o cualquiera de esas estupideces; y otros, subestimados, como el riesgo actual que presenta la gestión algorítmica de mucha información crítica y la toma de decisiones por esa vía. En el caso de agentes autónomos con capacidad letal, uno de los problemas está en que sus decisiones no siempre son transparentes para quienes las administran.

Por ese motivo, Musk creó la ONG Open IA (Inteligencia Artificial Abierta), que promueve el desarrollo de tecnología en código abierto para que se emplee en beneficio de la humanidad y de manera segura. Su rol, como repite en cada conferencia, es advertir. Como hizo con el CEO de Facebook tras escucharlo haciendo una oda a la inteligencia artificial en un videochat que realizó en su plataforma, desde la cocina de su casa. «